Med Runway skaber du liv i dine SoMe opslag!

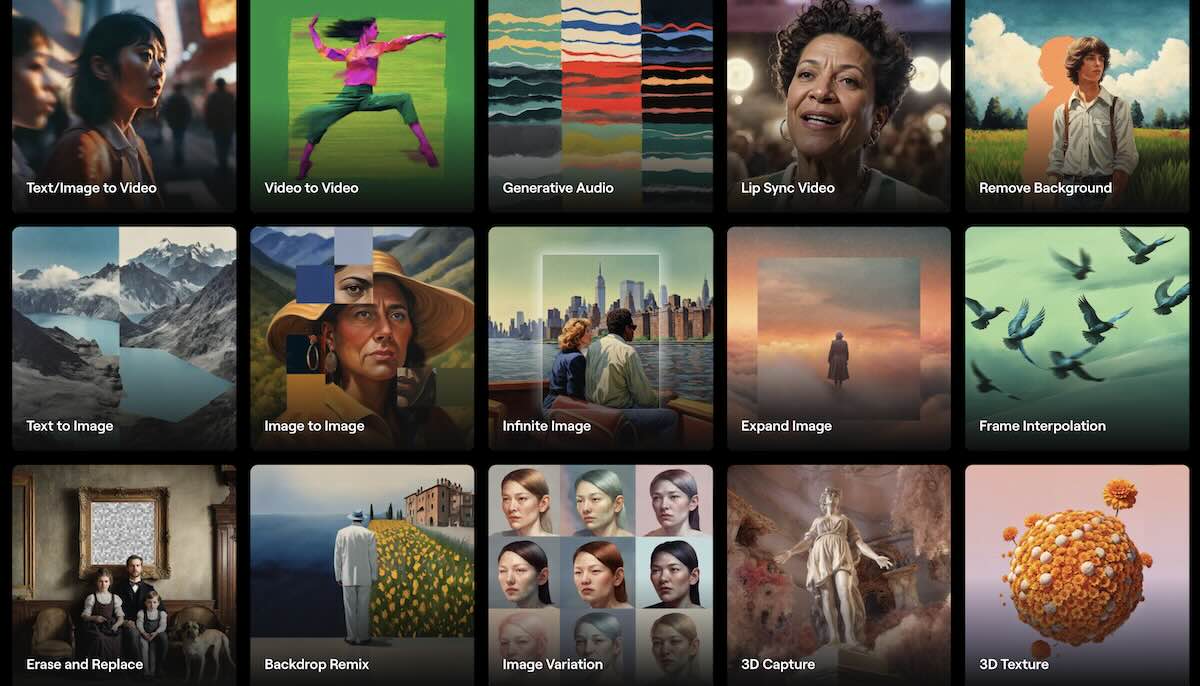

Jeg har tidligere skrevet om Runway AI som vel bedst kan beskrives som en hel pakke af video- og billedværktøjer af meget høj kvalitet. Mest imponerende er nok videoværktøjerne hvor du ud fra få tekstlinjer kan skabe meget realistiske videosekvenser, ligesom du kan konvertere stillbilleder til video.

Inden vi dykker ned i funktionerne med mest wow-faktor, er det dog på sin plads at nævne de mange andre virkelig gode værktøjer. Der er alt i simple, men effektive og anvendelige værktøjer der kan fjerne eller erstatte baggrunden i et billede, forbedre kvaliteten, ændre farver, skabe dybdevirkning, tilføje undertekster til video, lave super-slowmotion eller udskifte dele af et billede eller udvide til bredformat eller højformat med indhold der matcher det oprindelige billede.

Det bedste af det hele er at det kræver få eller ingen færdigheder for billedredigering fordi det hele er AI genereret, og du derfor blot beskriver med ord, hvad du vil opnå.

Det er altsammen super gode funktioner, men det helt store dyr på savannen er ubetinget videogenerering. Runway gør det muligt at skabe små videosekvenser på 10 sekunder, ved blot at beskrive med ord hvad klippet skal indeholde. Vi er stadig på et meget tidligt stadie, så du kan ikke forvente at få præcis det du beder om - modellen er meget kreativ i sin fortolkning af det du skriver. Du vil også opleve at der er fejl i anatomi, så en person får flere arme, mangler øjne mv. og så er det bare at prøve igen.

Udover at der ligger forskellige guides til hvordan du bedst "prompter" som det hedder (altså dine tekstinput) er teknikken at være kreativ i din historiefortælling. Dvs. du skaber din historie omkring de videosekvenser du får retur - i stedet for at lave din historie og så forvente at du kan generere video der understøtter det præcist.

I videoen herunder har jeg sammensat forskellige små klip som blot har til formål at vise kvaliteten og mulighederne. Jeg beder om close-ups af ansigter for at vise detaljeringsgraden, jeg beder om en smuk sommerfugl, glade børn og en catwalk for at vise bevægelse, men jeg har ikke specifikt bedt om udseende, baggrunde eller bestemte bevægelser. Jeg bruger derfor det jeg får og prøver at sætte det sammen med tekst, der giver billederne mening.

Video virker altid stærkere med musik - så derfor tilføjer jeg underlægningsmusik. Til det bruger jeg AI tjenesten Suno (læs om den her) hvor man kan generere musik enten instrumentalt eller med sang. I tilfældet her, har jeg skrevet en kort tekst der passer til videoklippene og forsøgt at få det til at passe med de forskellige skift i billederne.

Tjenesten fungerer med mange sprog, men udtalen på dansk er ikke god, så derfor har jeg lavet det på engelsk. Døm selv hvad du synes.

Image-to-video

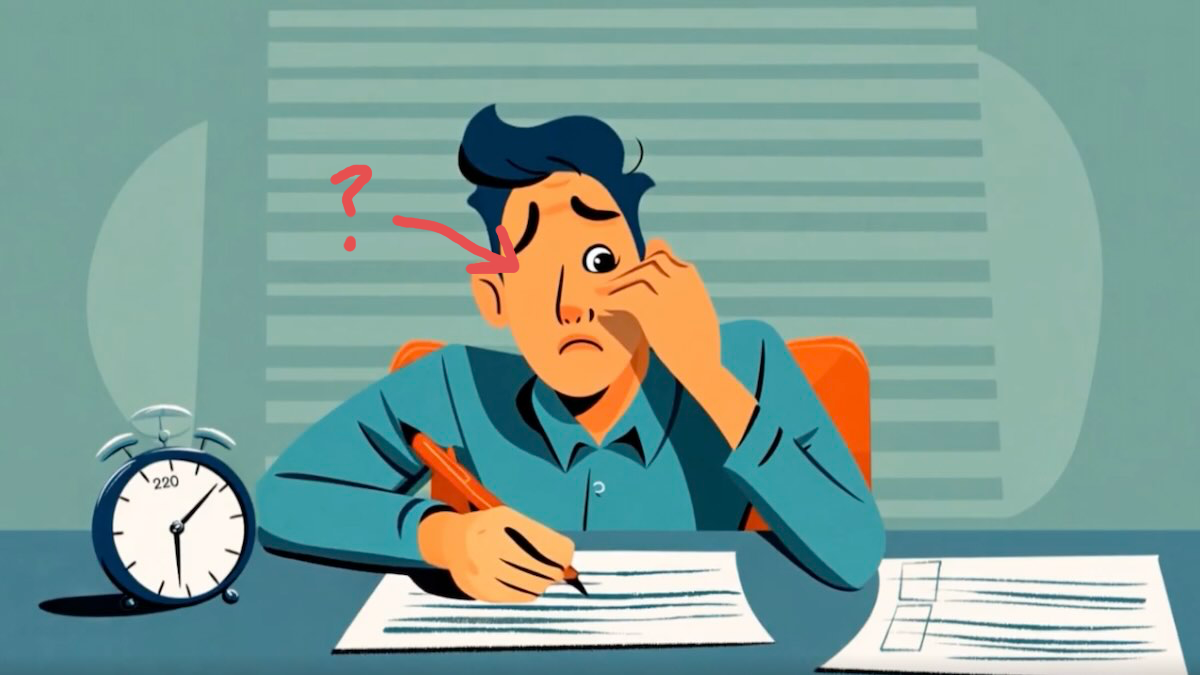

En af de andre helt store funktioner på Runway er "image-to-video". Som ordene siger, betyder det, at du kan konvertere et stillbillede til video - det er altså ret effektfuldt! I nedenstående eksempel har jeg genereret et stillbillede på Midjourney (læs mere her), men ville gerne gøre det lidt mere interessant og levende. Med funktionen image-to-video har jeg uploadet mit billede og givet tekstprompten "Cartoon character looks confused, scratches his head, then writes on the paper on the table in front of him."

Det gav mig i første omgang en video, som langt hen ad vejen gav mig hvad jeg bad om, men af uransagelige årsager havde karakteren mistet det ene øje. Jeg prøvede igen, men fik kun dårligere resultater, så i stedet lagde jeg den nye video ind i Final Cut Pro, kopierede det ene øje og placerede det hvor det andet skulle have været hele tiden. Sådan må man nogle gange sno sig lidt.

For at understøtte den Linkedin-post som videoen var tiltænkt, tilføjede jeg i FCP nogle talebobler og endnu engang lavede jeg lidt simpel underlægningsmusik i Suno. I stedet for et lidt uinteressant stillbillede er det nu blevet til en sjov lille video med lyd og tekst.

Hvis du har læst så hertil er det helt sikkert fordi du synes mulighederne er spændende og så er det bare med at komme i gang på https://runwayml.com/ God fornøjelse!